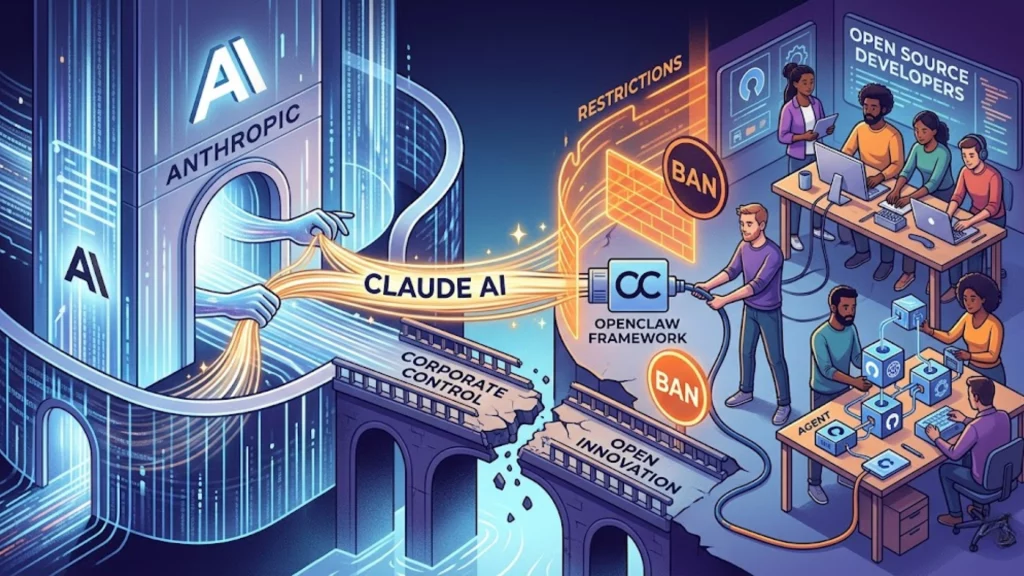

El baneo de Anthropic a OpenClaw: La guerra entre el código abierto y el control corporativo en la era de los agentes de IA

El ecosistema de la inteligencia artificial ha despertado ante una de las noticias más controvertidas de los últimos tiempos en el ámbito del desarrollo de software: el baneo temporal de Peter Steinberger por parte de Anthropic. Este incidente no es un hecho aislado ni un error técnico fortuito; es la culminación de una serie de tensiones crecientes entre la empresa creadora de Claude y la comunidad de código abierto, representada en este caso por OpenClaw, el framework de agentes de IA más popular del momento. Para entender la magnitud de este suceso, es necesario analizar las capas de estrategia comercial, competencia corporativa y sostenibilidad técnica que subyacen tras la decisión de una de las empresas de IA más valoradas del mundo.

Peter Steinberger, una figura reconocida en la comunidad tecnológica y actual empleado de OpenAI, ha sido el motor detrás de OpenClaw. Este framework ha logrado hitos impresionantes, alcanzando más de 135.000 instancias activas. Su propuesta es sencilla pero potente: permitir a los desarrolladores y empresas ejecutar agentes autónomos con memoria persistente y herramientas avanzadas utilizando los modelos de lenguaje más capaces del mercado. Sin embargo, el éxito de OpenClaw parece haberse convertido en su mayor problema ante los ojos de Anthropic. El bloqueo de la cuenta de Steinberger, aunque revertido posteriormente, deja preguntas inquietantes sobre la libertad de desarrollo en plataformas cerradas.

La raíz económica del conflicto reside en el uso de los recursos de computación. Hasta hace muy poco, los usuarios de Claude bajo suscripciones Pro y Max podían integrar sus cuentas con herramientas de terceros como OpenClaw. Esto permitía ejecutar procesos automáticos de manera ininterrumpida por una tarifa plana mensual. Según datos técnicos y estimaciones de la propia comunidad, los usuarios más intensivos de OpenClaw estaban extrayendo un valor operativo hasta 36 veces superior al coste de su suscripción. Para una empresa como Anthropic, que se encuentra en una fase de expansión agresiva y preparación para una posible salida a bolsa, este modelo de “barra libre” resultaba financieramente insostenible.

La respuesta de la compañía fue drástica y se ejecutó en varias fases. El primer movimiento significativo ocurrió el 20 de febrero, cuando Anthropic actualizó sus términos de servicio para prohibir explícitamente el uso de tokens OAuth en herramientas de terceros. Esta medida apuntaba directamente a la línea de flotación de frameworks como OpenClaw, que dependen de una integración fluida para funcionar. Posteriormente, el 4 de abril, la restricción se hizo efectiva, obligando a los usuarios a migrar del modelo de suscripción plana al pago por uso a través de la API oficial. Con precios de 3 dólares por millón de tokens de entrada y 15 dólares por millón de tokens de salida para modelos como Sonnet 4.6, la factura para los desarrolladores de agentes autónomos cambió radicalmente de la noche a la mañana.

Boris Cherny, responsable de Claude Code en Anthropic, ha defendido estas medidas bajo el argumento de la capacidad y el diseño del producto. Según la versión oficial, las suscripciones de consumo nunca fueron ideadas para soportar los patrones de uso de agentes autónomos que operan 24/7. La infraestructura necesaria para mantener la latencia y la calidad de respuesta de Claude se ve tensionada cuando miles de instancias de OpenClaw realizan peticiones masivas de forma automatizada. Desde un punto de vista de ingeniería de sistemas, el argumento es válido: el uso abusivo de una interfaz diseñada para humanos por parte de máquinas puede degradar el servicio para el resto de la base de usuarios.

No obstante, la cronología de los hechos añade una capa de sospecha que la comunidad no ha tardado en señalar. Peter Steinberger anunció su incorporación a OpenAI a mediados de febrero. Apenas unos días después, Anthropic comenzó a cerrar el cerco sobre OpenClaw. Steinberger ha sido vocal en sus críticas, sugiriendo que Anthropic ha seguido un patrón clásico de “capturar y cerrar”. Según su visión, la empresa primero observó cuáles eran las funciones más populares en los arneses de código abierto para luego integrarlas en sus propios productos cerrados, como Claude Dispatch, y simultáneamente bloquear el acceso a la competencia externa.

Este fenómeno no es nuevo en la historia de Silicon Valley, pero adquiere una dimensión crítica en la era de la inteligencia artificial. Estamos ante la lucha por el control de la capa de interacción. Anthropic no solo quiere vender el modelo (la inteligencia), sino también el entorno donde ese modelo se ejecuta (la plataforma). Al forzar a los usuarios a abandonar OpenClaw en favor de soluciones nativas o del pago estricto por API, Anthropic recupera el control sobre los datos, la experiencia de usuario y, lo más importante, los márgenes de beneficio.

El baneo de Steinberger, aunque calificado de temporal, envía un mensaje escalofriante a los desarrolladores de código abierto: si tu herramienta se vuelve demasiado exitosa o si tu perfil profesional se alinea con la competencia, tu acceso a la infraestructura crítica puede ser revocado sin previo aviso. Anthropic restauró el acceso tras el revuelo en redes sociales, pero el daño reputacional ya está hecho. La narrativa de “IA segura y ética” que la empresa ha cultivado con tanto esmero choca frontalmente con tácticas comerciales que muchos perciben como monopolísticas o punitivas.

A pesar del conflicto, surge una paradoja fascinante. El propio Steinberger ha admitido que, incluso con las restricciones, Claude sigue siendo el modelo preferido por los usuarios de OpenClaw debido a su calidad técnica y razonamiento superior. Esta es, quizás, la mayor victoria y el mayor dilema para Anthropic. Tienen un producto tan bueno que la comunidad está dispuesta a luchar por el derecho a usarlo, pero esa misma demanda es la que pone en jaque su modelo de negocio actual.

El futuro de los agentes de IA se encuentra ahora en una encrucijada. Por un lado, tenemos la visión de un ecosistema abierto donde los modelos son piezas intercambiables dentro de frameworks comunitarios. Por otro, el modelo de “jardín vallado” donde cada proveedor de IA intenta retener al usuario dentro de sus propias herramientas de gestión y despacho. La transición de OpenClaw hacia un modelo de pago por API en Anthropic es un paso hacia la madurez del mercado, donde el consumo de recursos debe ser pagado de forma proporcional, pero las formas en que se ha gestionado la transición dejan un sabor amargo en la comunidad dev.

Para los desarrolladores y empresas que dependen de estas tecnologías, la lección es clara: la diversificación es vital. Depender de un solo proveedor de modelo que también controla la plataforma de ejecución es un riesgo operativo significativo. La tendencia hacia modelos de código abierto como Llama o Mistral, que pueden ser desplegados en infraestructura propia, cobra más fuerza que nunca tras incidentes como este. Aunque Claude siga liderando en capacidades cognitivas, la confianza en la estabilidad de su plataforma se ha visto comprometida.

La tensión entre el código abierto y el control corporativo en la IA solo irá en aumento. A medida que los agentes autónomos se vuelven más capaces, su consumo de tokens crecerá exponencialmente, y las empresas proveedoras buscarán formas de maximizar sus ingresos. El caso de Anthropic y OpenClaw es el primer gran aviso de una batalla por la soberanía tecnológica en la que los desarrolladores independientes se encuentran atrapados entre gigantes.

El papel de Peter Steinberger en OpenAI también añade una nota picante a la historia. Es inevitable preguntarse si la reacción de Anthropic habría sido la misma si el creador de OpenClaw trabajara para una startup desconocida en lugar de para su principal rival. La política de talento en la industria de la IA es tan feroz como la competencia por los modelos, y en este tablero, cada movimiento cuenta. El bloqueo de una cuenta API puede ser visto como un error de algoritmo o como un movimiento de ajedrez corporativo.

En el largo plazo, Anthropic deberá decidir qué tipo de relación quiere mantener con la comunidad de desarrolladores. Si bien proteger los márgenes es una necesidad financiera, alienar a la base de usuarios que construye las herramientas que hacen que Claude sea útil es una estrategia peligrosa. Las plataformas que prosperan suelen ser aquellas que fomentan un ecosistema rico a su alrededor, no las que intentan devorar todas las funciones de terceros.

El incidente de OpenClaw quedará registrado como el momento en que las reglas del juego cambiaron para los agentes autónomos. La era de la experimentación gratuita o subvencionada ha terminado, dando paso a una fase de comercialización estricta. Para Anthropic, es un paso hacia la rentabilidad; para el código abierto, es una llamada de atención sobre la fragilidad de construir sobre cimientos ajenos. La industria observa con atención, sabiendo que este es solo el comienzo de una reestructuración profunda en la forma en que consumimos y desarrollamos inteligencia artificial a gran escala.

Finalmente, la resolución técnica del baneo y la vuelta al servicio de Steinberger no borran el precedente. Los desarrolladores ahora operan bajo la premisa de que sus herramientas pueden ser invalidadas por un cambio de política en cualquier momento. La búsqueda de alternativas locales y la soberanía de datos se convertirán en los pilares del desarrollo de IA en los próximos años, mientras las grandes corporaciones terminan de levantar sus muros para proteger sus inversiones multimillonarias en computación.